时间是残酷游戏,比如当惊艳的Apple Vision Pro终于出场,早已无人惦记遥远的诺基亚。

但包括未来将要登陆Apple Vision Pro的游戏开发者Ryan McLeod在内,一切手机游戏都需要向诺基亚在1997年首次将《贪吃蛇》内置的决定致敬,这个动作真正打开了手机游戏的历史。

《贪吃蛇》的游戏逻辑很简单,吃果子可以得分但身体会变长,控制方向不撞到边界或自己。时至今日诺基亚已经几乎离开大众视线,以《贪吃蛇》为根源的游戏仍然活跃,甚至“如何用最短的代码写出一个贪吃蛇游戏”至今仍然是开发者社区里有吸引力的话题。

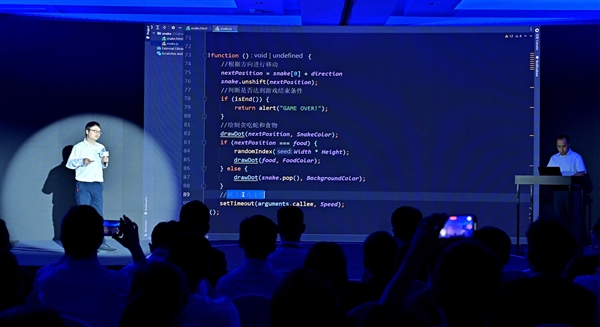

这个现在古典而充满美感的游戏也变成了大模型时代度量AI能力的尺子。百度智能云AI平台副总经理施恩在一个新的代码助手Comate帮助下,从画布开始搭建《贪吃蛇》,直到最终贪吃蛇扭动着出现,AI完成了其中大半的代码工作。

整个过程不到5分钟。

开发者的Comate

大模型短暂而剧烈的竞争直到现在,黑箱的迷雾仍未散去,外界的注意力正在变化。各种宏大愿景开始冷静下来,转换成对更具体事物的关注。比如生成式AI在当下究竟可以为行业带来什么新的生产力。

6月6日,在成都举行的文心大模型技术交流会上,百度开放了代码助手Comate邀测。这是一个与GitHub Copilot等代码编写助手相似,但用了更多中文注释和开发文档作为训练数据炼成的智能开发工具。在编码过程中,Comate可以根据开发者当前在编写的内容,推理出接下来可能的输入选择。

文心大模型是宏大的,Comate是具体的。

对于《贪吃蛇》的游戏开发(网页版本)过程来说,开发者首先要在画布上画底,然后设定键盘的操作方式以及游戏结束条件的判断,除此之外,就是爬行速度等环境要素的控制。对于Comate来说,只需要输入“canvas”,以及“弹性布局,水平居中,垂直居中”的中文备注,就可以完成游戏画布代码的生成。然后输入“param color”、“left”、”food=”等颜色、方向、食物的简单词,Comate会自动联系上下文理解指令,补全代码,并在多条推荐代码之间切换,选择合适代码后,直接生成了可运行的《贪吃蛇》游戏。

据百度介绍,目前Comate能力已经率先集成在百度所有业务线中并实现了很好的使用效果:核心研发部门中50%的代码可通过Comate生成。从去年开始Comate已经在百度内部进行了大量测试。测试结果显示,在“Comate”辅助编写的代码中,近50%的建议代码被开发者采纳,目前在百度内部已经广泛应用到各类产品开发中。

Comate深度学习的对象除了百度内部的代码库也包括高质量Github代码库。现在这个代码助手可以实现代码自动生成、代码自动补全、代码智能搜索、高质量代码推荐、测试代码自动生成等多种智能功能。推理速度上单请求可实现300ms左右,这意味着开发者不需要停下来等待代码生成,Comate完全可以匹配上开发者的编码速度。

当前Comate代码助手支持主流开发语言/框架30余种,对于C/C++、Java、Python等主流语言Comate专门做了数据优化,可达到更好的代码推荐效果。此外,Comate还支持前后端、软硬件不同场景、以及程序员常用的多种IDE。

从这个角度来看,《贪吃蛇》是一次直观却并不充分的演示。施恩也表示,《贪吃蛇》的代码开发其实已经可以完全依靠大模型来不加干涉的自动生成。只不过有趣的是,Comate从原本百度内部智能工作平台推出的一个“代码推荐工具”到现在的“代码生成助手”,本身也得益于大模型的能力加持。

百度智能云AI平台副总经理施恩 图源:百度

Comate的孵化开始于2018年左右,百度内部在寻找提升开发效能的办法时已经提到了代码生成。但技术不够成熟,所以先选择通过检索算法并做算法推荐的方式来提效。“那时候技术探索已经在尝试了。但在文心大模型出现之后,我们才把真正的代码生成在更广泛的场景应用起来”,百度智能云AI平台副总经理李景秋对品玩表示。

Comate从搜索逻辑过渡到生成逻辑,大模型的能力开始在开发环节呈现出生产力变革的姿态。而如果说Comate是文心大模型对开发者的一次回答,那“文心一言- Turbo”则是文心一言上线两个月后,百度给产业交出的一个新方案。藏于其后的,是文心千帆大模型平台在两个月后逐渐清晰的迭代路线。

文心千帆的迭代方向:效果+效率

百度将文心千帆定义为全球首个一站式的企业级大模型平台。具体来看,文心千帆不仅提供包括文心一言底层模型(Ernie bot)在内的大模型服务,还提供了各种AI开发工具链和整套开发环境。此外,大模型平台还支持各类第三方的开源和闭源的大模型。自3月27日首次启动内测开始,在文心千帆的支撑下,文心一言在两个月内完成了四次技术迭代。

在4月25日的一场技术交流会上,百度集团副总裁侯震宇透露自内测以来,通过算法和模型的持续优化,文心一言推理效率提升10倍,推理成本降为原来十分之一。一个半月后,文心一言的高性能模式“文心一言- Turbo”作为文心千帆第一阶段迭代的结语成果出现。在一些高频、核心场景,在满足同样客户需求的情况下,推理服务的整体性能总共提升了50倍。

多次迭代后,文心千帆的两个进化方向也已经显现出来:效果和效率。

在效果上,除了推理性能的大幅提升外,“文心一言- Turbo”支持SFT训练,同时针对不同场景和效果提供多种训练方式,Bloom7B(70亿参数)第三方大模型可支持 P-tuning、SFT、Lora等不同训练方式。并且由于企业对于大模型再训练的需求以及私有化部署的考虑,文心千帆将开放插件协议,能够让第三方企业基于插件协议共享插件,通过插件的方式,把内部的数据完全接入,同时实现更好的大模型效果。

除此之外,文心千帆将会提供一部分预制的Prompt模板,同时支持Prompt模板的增删改查以及支持参数插值的调用模板,支持通过服务接口形式调用Prompt模板,用于获得更好的推理效果。

与效果并行的则是效率,或者也可以理解成性价比。

“文心一言- Turbo”推理效率的50倍增长意味着大模型推理成本的大幅下降,这将是文心一言大模型内测仅一个月后,大模型推理成本降为原来1/10之后的又一次提升。并且在数据标注方面,“文心一言- Turbo”未来能够批量生成标注数据并快速用于后续训练,相比于此前手动的数据标注形式将会大大降低数据标注成本。

在部署方式上,文心千帆也在逐步增加应对客户的灵活度。

文心千帆对外提供“3+3”的交付方式。在公有云服务侧提供推理(直接调用大模型的推理能力)、微调(通过高质量精标业务数据,高效训练出特定行业的大模型)、托管(将模型发布在百度智能云,以实现更加稳定高效的运行)三种服务来降低企业部署大模型的门槛。

而在颇受关注的私有化部署侧,文心千帆支持软件授权(提供在企业环境中运行的大模型服务)、软硬一体(提供整套大模型服务及对应的硬件基础设施)以及租赁服务(提供机器和平台的租赁满足客户低频需求)。其中最新加入的租赁服务意在满足预算有限,或对模型训练需求更低频的客户。

文心千帆大模型平台在两个月内急速的迭代脚步,以及在效果和效率两端清晰的路线规划,并不只是算力的优势作用,背后体现出更多的是百度AI四层架构的整体优势。

李彦宏 图源:搜狐

李彦宏曾公开表示,百度是全球唯一在芯片、框架、模型和应用这四层进行全栈布局的人工智能公司。昆仑芯作为百度在底层芯片上的布局,已经有两代产品实现数万片的部署,第三代预计在明年年初量产;飞桨已经是国内综合市场份额第一的深度学习框架;文心大模型家族中除了文心一言,还有包括NLP、CV、跨模态等通用大模型及11行业大模型,并与应用层的丰富积累互为羽翼卷起数据飞轮。这个完整布局也让当下文心千帆在面对300家生态伙伴以及400多个企业内部场景时有了灵活进化的前提条件。

文心千一言每一次技术演进都是从芯片层到框架层、到模型层以及应用层多个团队的共同努力。“我们内部会拉一个工作群,这里有昆仑芯片的人,有飞桨框架团队的人,有大模型NLP算法策略的人,也有我们大模型平台工具链的人,还有终端应用智能客服的人。每个月会设定共同的目标,比如这个月性能必须提升到什么样的水平。”李景秋表示。

也如百度集团副总裁侯震宇在5月初的一次闭门会上所说,“大模型时代下,企业的创新要脱颖而出,不但需要智能的算力、灵活的框架平台、丰富的大模型体系以及优质的应用方案,还需要这四者之间端到端的适配与优化,这是一个‘既要、又要、还要’的端到端创新工程。”

而几乎所有人都能感觉到,百度在大模型这一仗上,开始显出后劲了。

文章为作者独立观点不代表轻创业客+立场,未经允许不得转载。

浙公网安备 33038202004573号

浙公网安备 33038202004573号